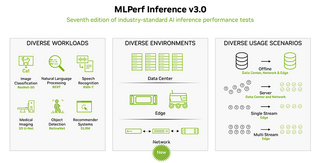

Бенчмарк MLPerf, а вернее, его набор тестов Training, в основном является вотчиной NVIDIA с небольшими вкраплениями результатов ускорителей иных архитектур вроде Google TPU. Но MLPperf Inference более демократичен. В частности, в последнем раунде v2.1 отметилось сразу несколько новых систем и архитектур.

Опубликованы новые результаты были в двух категориях, Open и Closed, и в обоих случаях в списках замечены новинки. В частности, в «открытой» категории появились результаты процессора Alibaba Yitian 710, довольно высокие и без дополнительных ускорителей, что, впрочем, неудивительно — этот чип с архитектурой Armv9 располагает 128 ядрами с частотой до 3,2 ГГц и имеет поддержку всех современных форматов данных.

Alibaba Yitian 710. Источник: Alibaba Cloud

В этой же категории дебютировали PCIe-ускорители Moffett AI S4, S10 и S30. В основе этих решений лежит архитектура Moffett Antoum, специально спроектированная для работы с «разреженными» (sparsity) моделями. S4, младшая модель серии, располагает 20 Гбайт памяти LPDDR4x, потребляет 70 Вт, но при этом развивает 943 Топс на вычислениях INT8 и 471 Тфлопс в режиме BF16 при коэффициенте sparsity, равном 32x. Старшие варианты, судя по всему, несут на борту по 2 и 3 процессора Moffett AI Antoum.

Архитектура Moffett S4. Источник: Kisaco Research

Это выливается в очень неплохие результаты в ResNet50 даже для S4. Более мощные ускорители S10 и S30 демонстрируют пропорциональный прирост производительности, составляющий 2х и 3х соответственно. Впрочем, в графе точность (accuracy) в результатах есть некоторый разброс. Интересно, что Antoum содержит в своём составе аппаратные декодеры видео (64 потока [email=1080p@30)]1080p@30)[/email] и JPEG-изображений (2320 к/c с разрешением 1920x1080), так что процессор действительно хорошо подходит для инференс-систем, где требуется быстрая обработка входящих изображений или видео.

Moffett S4. Источник: Kisaco Research

Из прочих архитектур отметились ускорители Qualcomm Cloud AI 100, но не всех категориях бенчмарка. А вот в категории Closed куда «многолюднее», хотя основную массу населения и составляют решения NVIDIA. Но, во-первых, компания продемонстрировала результаты H100, что выглядит весьма интересно в сравнении ускорителями A100 в различных вариациях, а также с менее мощными ускорителями A30 и A2.

Ускорители Sapeon. Источник: Korea IT News

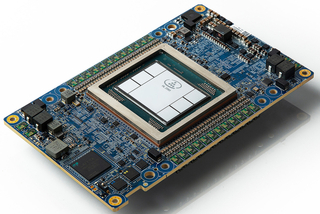

Во-вторых, в этой же категории появилась новинка — ускоритель Sapeon X220 от южнокорейской SK Telecom. Одно из его назначений — качественный апскейл видеоконтента с низким разрешением, например, из FullHD в 4K. Для ResNet-50 заявлена производительность 6700 к/с. Главное преимущество X220 перед современными GPU — энергоэффективность, и по этому параметру он в 3,5 раза опережает ускорители сопоставимого класса.

Источник: SK Telecom

Наконец, в Inference v2.1 можно увидеть результаты загадочного китайского соперника NVIDIA A100 — ускорителя серии BR100 от Biren Technology, о котором мы не столь давно рассказывали . Он действительно показал результаты, сопоставимые с NVIDIA A100. При этом речь идёт о PCIe-версии BR100, ограниченной теплопакетом 300 Вт, в то время как в варианте OAM c TDP 550 Вт результаты такого модуля могут оказаться выше даже в сравнении с A100 в исполнении SXM.

Источник: Biren Technology

Также следует отметить и результат двухпроцессорной системы на базе Intel Sapphire Rapids. Хотя речь и идёт о процессоре общего назначения, поддержка инференс-нагрузок позволила Sapphire Rapids бороться на равных или даже опережать NVIDIA A2. Таким образом, наблюдать за MLPerf явно стало интереснее. Пока этого нельзя сказать про раздел Training, но в разделе Inference уже имеется достаточно результатов для представляющих интерес сравнений и выводов.

Источник новости: servernews.ru