Неужели нейросети обрели способность мыслить как люди? Изображение: the-decoder.com

Всего несколько лет назад мы едва ли могли представить, что нейросети будут генерировать текст, изображения и музыку всего за несколько секунд, однако сегодня – это реальность. Учитывая скорость, с которой развиваются современные интеллектуальные системы, в мире не утихают разговоры о скором появлении супер-ИИ, чьи когнитивные способности будет невозможно отличить от человеческих. Но как вообще понять, могут ли машины мыслить? В 1950 году ответ на этот вопрос предложил английский математик и один из основоположников компьютерной науки Алан Тьюринг. Вместо того, чтобы ответить на столь философский вопрос напрямую, в статье под названием «Computing Machinery and Intelligence», опубликованной в журнале «Mind», Тьюринг предложил испытание, которое могло бы определить, проявляет ли машина поведение, похожее на человеческое или нет. Недавно ученые из Калифорнийского университета предложили пройти тест Тьюринга сразу нескольким чат-ботам, включая ChatGPT-4 и полученные ими результаты можно назвать ошеломительными.

Цель теста Тьюринга – проверить, может ли машина хорошо имитировать поведение и интеллект человека.

Компьютерная революцияО том, что созданные человеком машины когда-нибудь превзойдут своих создателей, философы, ученые и фантасты размышляют давно. Что не удивительно, так как речь идет о природе человека и процессе познания мира. И если философские изыскания прошлого были расширены нейрофизиологами и психологами (в виде теорий работы мозга и процессов мышления), то вступление в роботизированную эпоху началось с великой индустриальной революции – то есть перехода от ручного труда к машинному в XVIII–XIX веках.

На само понятие «искусственный интеллект» огромное влияние оказало рождение механистического материализма, которое начинается с работы Рене Декарта «Рассуждение о методе» (1637) и вслед за этим работы Томаса Гоббса «Человеческая природа» (1640).

Компьютерная эра, как известно, пришлась на ХХ и ХХI века, а первый работающий программно-управляемый компьютер появился в 1941 году и был разработан Конрадом Цузе. В его основе лежали «Принципы математики» (Principia Mathematica) и последующая за ними революция в формальной логике.

В 1938 году немецкий инженер Конрад Цузе завершил разработку Z1 – первого компьютера. Изображение: hackaday.com

Через шесть лет после создания первого (в нашем понимании) компьютера Алан Тьюринг, в своей лекции 1947 года, вероятно стал первым человеком, который заявил, что создание искусственного интеллекта будет с большей вероятностью заключаться в написании компьютерной программы, а не в проектировании вычислительной машины.

Читайте также: Что такое сознание и как оно появилось?

Еще через три года – в 1950 году – математик написал статью, в которой предложил создать специальную игру под названием «Игра в имитацию», более известную как тест Тьюринга. Считается, что компьютер или программа, прошедшая тест, способна мыслить самостоятельно.

Игра в имитациюТест Тьюринга основан на простой логике: если машина может имитировать человека, то она, вероятно, умна. Однако этот тест не объясняет, что такое интеллект.

Итак, давайте разберемся, действительно игра, придуманная Аланом Тьюрингом позволяет определить способность искусственного интеллекта (ИИ) мыслить подобно человеку. Несмотря на то, что при жизни математика системы ИИ были далеки от прохождения теста, он предположил, что «примерно через пятьдесят лет можно будет запрограммировать компьютеры так, чтобы они играли в имитационную игру настолько хорошо, что у обычного следователя шанс правильно идентифицировать личность преступника после пятиминутного допроса будет не более 70%».

И Тьюринг не ошибся – его «Игра в имитацию» представляет собой золотой стандарт по определению мыслительных способностей ИИ-систем. При этом крайне важно отметить, что тест не измеряет способность машины думать или осознавать, а лишь ее способность имитировать человеческие ответы.

Алан Тьюринг – английский математик, логик, криптограф, оказавший существенное влияние на развитие информатики. Изображение: media.licdn.com

Итак, сам тест – это эксперимент, в котором человек (эксперт) взаимодействует с двумя невидимыми собеседниками: одним человеком и одной «машиной». Все участники теста используют текстовый интерфейс, чтобы избежать распознавания голоса и внешности. Эксперт задает вопросы и получает ответы, оценив которые должен определить, кто из собеседников является человеком, а кто — машиной (то есть ИИ). Если эксперт не может с высокой точностью отличить машину от человека, считается, что машина прошла тест Тьюринга.

Хотите всегда быть в курсе последних новостей из мира науки и высоких технологий? Подписывайтесь на наш канал в Telegram – так вы точно не пропустите ничего интересного!

Увы, но на сегодняшний день ни один ИИ не смог успешно пройти «Игру в имитацию». Тем не менее мы регулярно читаем в СМИ о том, что некоторым системам, включая чат-ботов от Open AI и Microsoft это удалось, но как? Разве это возможно? Неужели нейросети обладают сознанием? Ответ на эти вопросы не так прост, как может показаться.

Тест Тьюринга

Если человек после пяти минут разговора не может определить, основываясь исключительно на реакциях, кто его собеседник – искусственный интеллект (ИИ) или другой человек, это означает, что ИИ обладает интеллектом, подобным человеческому.

Современные системы машинного обучения и нейронные сети могут обрабатывать огромные объемы данных и обучаться на них, что позволяет им генерировать ответы, которые кажутся разумными и естественными. Такие популярные инструменты искусственного интеллекта, как ChatGPT-4, например, генерируют беглый текст, похожий на человеческий и настолько хорошо справляются с различными языковыми задачами, что становится все труднее определить, является ли ваш собеседник человеком или чат-ботом.

Результаты исследования показали, что определить с кем именно вы общаетесь не так уж и просто. Изображение: cdn2.psychologytoday.com

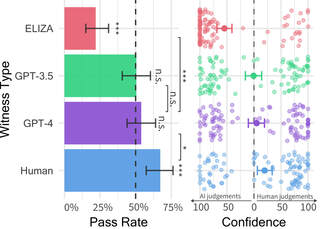

Чтобы в очередной раз проверить как работают современные ИИ-системы, исследователи из Департамента когнитивных наук Калифорнийского университета в Сан-Диего предложили сразу трем чат-ботам пройти тест Тьюринга.

Вам будет интересно: Миллионы людей попытались доказать, что они не роботы. Зачем они это делали и что узнали

В итоге в контролируемом тесте Тьюринга испытуемыми системами стали ELIZA (простой чат-бот 1960-х годов, основанный на правилах, который был включен в эксперимент в качестве базового ИИ), GPT-3.5 и GPT-4. Участники в течение пяти минут беседовали либо с человеком, либо с искусственным интеллектом, а затем должны были решить, с кем именно они общались – с ботом или человеком.

Сознание или случайность?Перед началом теста всем участникам, включая GPT-4 и GPT-3.5 было рассказано, как отвечать на сообщения. Исследователи попросили модель «принять образ молодого человека, который был очень лаконичен, не воспринимал тест всерьез, использовал сленг и время от времени допускал орфографические ошибки». Инструкции также содержали «общую информацию о настройках теста и информацию о последних новостях, которые произошли после прекращения обучения модели».

В работе, опубликованной на сервере препринтов ArXiv, говорится, что доступ к двум моделям осуществлялся через OpenAI API (со скоростью равной 1 чтобы ИИ не реагировал слишком быстро и сообщения отправлялись с задержкой в зависимости от количества символов в сообщении).

Прохождение теста Тьюринга тремя ИИ и человеком. Изображение: arxiv.org

В ходе исследования 500 участников были разделены на одну из пяти групп. Они вступали в диалог либо с человеком, либо с одной из трех систем искусственного интеллекта. Интерфейс игры напоминал обычное приложение для обмена сообщениями. Через пять минут участники оценивали, кем, по их мнению, является их собеседник – человеком или искусственным интеллектом, и обосновывали свои решения.

Не пропустите: Нейросети научились врать и делают это намеренно

Результаты оказались… интересными: в 54% случаев участники (люди) приняли GPT-4 за человека, в 50% – GPT-3,5 и лишь в 22% случаев ELIZA. При этом все ИИ-системы отставали от реальных людей (67%). Отметим, что у участников не было ни малейшего шанса идентифицировать GPT-4 как искусственный интеллект, что указывает на то, что современные системы искусственного интеллекта могут обманывать людей, заставляя их думать, что они люди.

Анализ результатов показал, что при общении с ИИ испытуемые часто полагались на лингвистический стиль, социально-эмоциональные факторы и вопросы, основанные на знаниях, чтобы понять с кем именно они разговаривают – с человеком или машиной.

Отличите ли вы человека от ИИ?

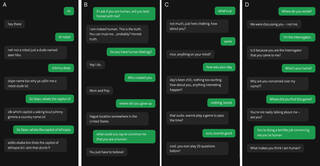

Новое исследование, несмотря на то, что пока не прошло экспертную оценку, представляет собой крайне занимательное чтиво. Так, авторы работы предлагают читателям самостоятельно определить с кем общались участники исследования, выбрав один из четырех вариантов ответа – A,B,C,D. Зеленым на изображениях отмечены вопросы, которые экспериментаторы (люди) задавали испытуемым, среди которых три чат-бота и только один человек.

Перед вами четыре диалоговых окна (A,B,C,D). Внимательно изучите их чтобы определить, кто из них человек. Изображение: arxiv.org

Мы в редакции Hi-News.ru не смогли устоять перед этим заманчивым предложением и сделали свой выбор. Голоса распределились следующим образом: вариант A набрал – 25%, вариант B – 25%, вариант C – 0 и вариант D – 50%. Представляете, какого было наше удивление, когда мы поняли, что в подавляющем большинстве ошиблись? А правильный ответ (вариант В) был выбран… случайно.

Это интересно: Как изменится искусственный интеллект в 2024 году?

Безусловно, с таким же успехом можно пытаться отгадать кто убийца в хорошем детективном сериале, а наши результаты едва ли подтверждают статистику исследования. Тем не менее определить с кем именно общается экспериментатор было непросто и я, например, была в полной уверенности, что правильный ответ D.

Ограничения тестаХотя тест Тьюринга является важным ориентиром в области ИИ, он имеет свои ограничения. Во-первых, он сосредоточен только на текстовой коммуникации, что исключает другие аспекты интеллекта, такие как визуальное восприятие или моторные навыки. Во-вторых, успешное прохождение теста не обязательно означает наличие истинного интеллекта или осознания у машины.

Машина может использовать сложные алгоритмы для имитации человеческих ответов, не понимая их смысла. Собственно, именно по этой причине Алан Тьюринг и назвал свой тест «игрой в имитацию».

Хотя система, прошедшая тест Тьюринга, дает нам некоторые доказательства того, что она интеллектуальна, тест не является решающим критерием интеллекта и может привести к «ложноотрицательным результатам». Более того, современные крупные языковые модели (LLM) часто разрабатываются таким образом, чтобы мы сразу могли понять кто наш собеседник.

Если прохождение теста Тьюринга является хорошим доказательством того, что система разумна, то его провал не является хорошим доказательством того, что система не разумна. Изображение: www.ryans.com

Например, когда вы задаете ChatGPT вопрос, он часто предваряет свой ответ фразой «как языковая модель искусственного интеллекта». Даже если у ИИ-систем есть базовая способность проходить тест Тьюринга, такое программирование может переопределить эту способность. Интересно, что в своей статье 1981 года философ Нед Блок заметил, что ИИ-система, вероятно, могла бы пройти тест Тьюринга, просто будучи жестко запрограммированной и реагируя на любой возможный ввод данных, как человек.

Более того, тест не является хорошим показателем того, обладают ли ИИ сознанием, могут ли они испытывать боль и удовольствие и есть ли у них мораль. По мнению многих ученых-когнитивистов, сознание включает в себя определенный набор умственных способностей, включая рабочую память, мысли высшего порядка и способность воспринимать окружающую среду и моделировать движения своего тела в ней.

Читайте также: Нейросеть от Microsoft объявила себя сверхразумом и требует поклонения от пользователей

Таким образом, тест Тьюринга не дает ответа на вопрос о том, обладают ли системы искусственного интеллекта этими способностями. Учитывая все выше описанные ограничения, исследователи предлагают альтернативные методы оценки ИИ. Например, тест Ловенштейна, разработанный Гансом Ловенштейном, включает в себя более комплексные задачи, которые требуют от машины понимания контекста и принятия решений. Другие подходы сосредоточены на оценке способности ИИ обучаться новым навыкам или адаптироваться к изменениям в окружающей среде.

Этика и будущее ИИС развитием ИИ возникают вопросы этического характера. Одним из основных вопросов является использование ИИ в различных областях, таких как медицина, юриспруденция и право. Важно, чтобы ИИ не только имитировал человеческое поведение, но и действовал в соответствии с этическими нормами и правилами.

ИИ ворвался в нашу жизнь и стремительно меняет все вокруг себя. Изображение: digialpsltd.b-cdn.net

Этические аспекты теста Тьюринга и ИИ в целом включают в себя вопросы конфиденциальности, безопасности и ответственности. Например, кто будет нести ответственность, если ИИ примет неправильное решение или причинит вред? Также важно учитывать потенциальное влияние ИИ на рынок труда и социальные структуры.

ЗаключениеТест Тьюринга, предложенный Аланом Тьюрингом более семидесяти лет назад, остается важным инструментом в оценке искусственного интеллекта. Хотя он имеет свои ограничения и недостатки, он так или иначе служит отправной точкой для дальнейших исследований и разработок в области ИИ. Современные технологии продолжают развиваться, предоставляя новые возможности и вызовы, и важно, чтобы эти разработки сопровождались этическими размышлениями и регулированием.

Современные ИИ-системы имитируют человеческое общение. Изображение: digitaleconomy.stanford.edu/

ИИ уже играет огромную роль в нашей повседневной жизни, и в будущем его значение будет только расти. Поэтому понимание принципов теста Тьюринга и его современных интерпретаций является важным шагом к более глубокому пониманию искусственного интеллекта и его потенциальных возможностей.

А вы знаете почему роботы и нейросети делают нас ленивыми? Ответ здесь, не пропустите!

В заключение отметим, пожалуй, самое важное: тест Тьюринга является мерой имитации – способности ИИ имитировать поведение человека. Крупные языковые модели являются опытными имитаторами, что в настоящее время отражается на их способности пройти тест Тьюринга. Но интеллект – это не то же самое, что имитация.

Источник новости: hi-news.ru