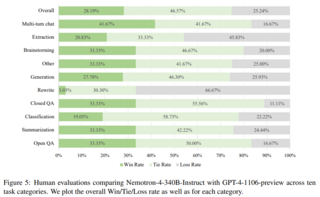

Сравнение Nemotron-4 340B с GPT-4-1106

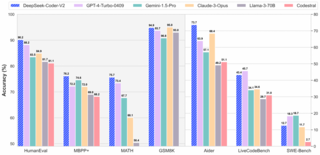

На данный момент самая крупная, после DeepSeek-V2 236B, открытая LLM модель размером 340B. По тестам сравнения человеком как выигрывает у GPT-4-1106 (вышла в ноябре 2023), так и проигрывает, но чаще составляет паритет.

Обучалась на 50+ естественных языках и 40+ языках программирования. Архитектура модели построена на Grouped-Query Attention (GQA) и Rotary Position Embeddings (RoPE). Но длина контекста всего 4096 токенов.

Модель представлена в виде: Nemotron-4-340B-Base, Nemotron-4-340B-Instruct и Nemotron-4-340B-Reward.

Base - предназначена для генерации синтетических данных.

Insctuct - предназначена для чата и выполнения инструкций

Reward - base модель с дополнительным линейным слоем для обучения используя новый подход reward.

Модель распространяется под лицензией NVIDIA Open Model License Agreement, разрешающая коммерческое использование.

Сама модель может и в стихи, так как обучалась и на русском языке:

Онлайн демо: https://chat.lmsys.org/ (там выбрать Direct Chat)

Веса модели: https://huggingface.co/nvidia/Nemotron-4-340B-Instruct

safetensors: https://huggingface.co/failspy/Nemotron-4-340B-Instruct-SafeTensors

Больше подробностей в пресс-релизе.

Самая большая загадка - сможет ли 1 битное квантование gguf позволить запустить её локально, и что даст эта модель для сообщества llm.

Источник новости: habr.com