Группа исследователей математики и ИИ в Microsoft Asia спроектировала и разработала небольшую языковую модель (SLM) под названием rStar-Math, которую можно использовать для решения математических задач. Группа опубликовала статью на сервере препринтов arXiv, где описываются технология и математика, лежащие в основе нового инструмента, а также итоги его тестов.

SLM, которые, как следует из их названия, меньше и, следовательно, гораздо менее ресурсоёмки. Некоторые из них даже могут работать локально на устройстве. Один из основных способов, которым исследователи ИИ наилучшим образом используют SLM, — это сужение фокуса и ответы на вопросы в конкретной сфере. В Microsoft сосредоточили свои усилия не только на решении математических задач, но и на обучении SLM тому, как рассуждать о решении проблемы.

Разрабатывая свою модель, исследователи заложили в неё возможность использования более крупными. Вероятно, новые LLM будут представлять собой именно объединение многих SLM. Примечательно, что объявление Microsoft появилось вскоре после дебюта её SLM Phi-4, которая также служит для решения математических задач.

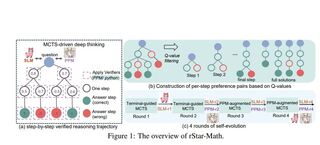

Исследователи отмечают, что rStar-Math работает иначе, чем Phi-4, используя поиск по дереву Монте-Карло — метод рассуждения, разработанный для имитации того, как люди решают проблемы пошагово. Они поясняют, что, используя такой подход, SLM может разбить проблему на более мелкие части, чтобы выяснить, как решить её. Исследователи подчёркивают, что rStar-Math выводит свой мыслительный процесс как в коде Python, так и на естественном языке.

rStar-Math включает три инновации: новый метод синтеза данных CoT с дополненным кодом, который выполняет обширные развёртывания с помощью поиска по дереву Монте-Карло для генерации пошаговых рассуждений, новый метод обучения с вознаграждением за процесс, который избегает наивной аннотации оценок на уровне шагов, а также рецепт саморазвития, в котором политика модели и её предпочтений создаются с нуля и итеративно развиваются.

После четырёх раундов обучения с миллионами синтезированных решений для 747 тыс. математических задач rStar-Math показала неплохие результаты. В тесте MATH показатели Qwen2.5-Math-7B улучшились с 58,8% до 90,0%, а Phi3-mini-3.8B — с 41,4% до 86,4%, превосходя o1-preview на 4,5% и 0,9% соответственно. На математической олимпиаде США (AIME) rStar-Math решает в среднем 53,3% (8/15) задач.

Команда планирует сделать код и данные rStar-Math общедоступными на GitHub.

В начале января Microsoft выпустила модель Phi-4 в качестве полностью открытого проекта с загружаемыми весами на Hugging Face. Этот релиз предоставляет исследователям и разработчикам полный доступ к 14 миллиардам параметров модели, позволяя проводить эксперименты и внедрять решения без ограничений по ресурсам.

Источник новости: habr.com