Компания Google Cloud представила на конференции для разработчиков Google I/O инстансы Google Compute Engine A3, специально созданные для обеспечения максимальной производительности рабочих нагрузок машинного обучения. Новинки используют современные CPU, быструю память, ускорители NVIDIA и IPU Intel.

Виртуальная машина A3 включает:

Помимо того, что новые инстансы используют DPU/IPU Mount Evans, разработанные совместно с Intel, кластеры A3 также задействуют фирменные оптические коммутаторы Google Jupiter с возможность переконфигурации топологии по требованию, которые компания уже использует в кластерах с собственными ИИ-ускорителями. Всё это позволяет объединять до 26 тыс. ускорителей H100 в облачный ИИ-суперкомпьютер производительность до 26 Эфлопс.

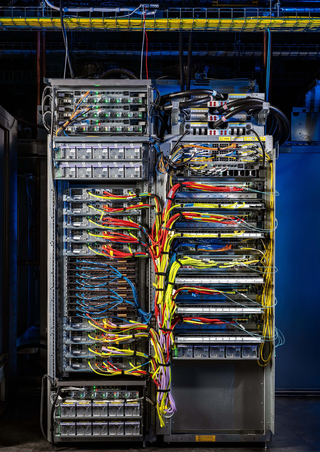

Изображение: Google

Ключевое отличие от других облачных предложений именно в интерконнекте и масштабируемости. Например, ИИ-суперкомпьютеры в Microsoft Azure объединяют тысячи и даже десятки тысяч ускорителей с использованием InfiniBand и DPU NVIDIA. В Oracle Cloud Infrastructure (OCI), где ранее был поставлен рекорд по объединению 32 768 ускорителей, используется тот же подход. Наконец, в AWS можно объединить до 20 тыс. ускорителей благодаря EFA.

Google предложит клиентам несколько вариантов использования A3: клиенты смогут запускать ВМ самостоятельно или в качестве управляемого сервиса, где Google возьмёт на себя большую часть работы. Возможно использование A3 в Google Kubernetes Engine (GKE) или в Vertex AI. В настоящее время виртуальные машины A3 доступны только после регистрации в списке ожидания превью. Сейчас компания занята развёртыванием множественных кластеров A3 в наиболее крупных облачных регионах.

Источник новости: servernews.ru